AI vanuit het perspectief van een investeerder.

Part I: Is AI een bubble? Zijn AI-waarderingen knettergek?

AI is tegenwoordig overal, en is in zekere zin een hype. Zelfs het aantal LinkedIn-posts over AI zit momenteel in bubble-territory.

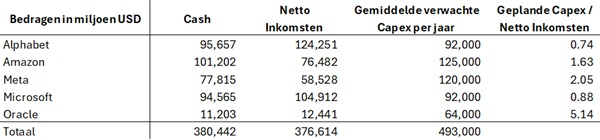

In tegenstelling tot de SPAC-, Weed- of Meme-bubble wordt de AI-hype echter wél onderbouwd door echte investeringen: Meta bouwt op dit moment een datacenter ter grootte van Manhatten. En hoewel er weliswaar wat circulariteit zit in de commitments van OpenAI, Nvidia en Oracle, wordt het gros van de investeringen wel degelijk gedragen door échte cashflows bij de meeste van de grote techspelers.

Alleen de investeringen van Oracle doen wat de wenkbrauwen fronsen, waarbij de geplande investeringen zeer hoog ogen in vergelijking met het huidige niveau aan inkomsten…

Wat waarderingen betreft: die zijn uiteraard wél fors. Zo noteert Nvidia aan een forward price/earnings van een forse 38.4x. En dat terwijl het verdienmodel van de grote AI-spelers nog ietwat een vraagstuk blijft. Maar daarover later deze week meer, in een volgend stukje. Toch volgen we de meest dramatische krantenkoppen niet: Krankzinnig zouden we de huidige waarderingen (nog?) niet noemen: Op het toppunt van de dotcom-bubble in 1999 noteerde Microsoft aan een P/E van 71x, en Cisco noteerde zelfs aan 171x de winst.

AI heeft dus zeker een hype-gehalte. Maar een echte zeepbel mogen we het vooralsnog niet noemen…

Part II: Divergentie of winner takes all?

De huidige bouwwoede en strijd om almaar grotere datacenters kan de indruk wekken dat de AI-markt een ‘winner takes all’ model wordt. Een beetje zoals Google een marktaandeel van 90% heeft over zoekopdrachten. Waarbij netwerkeffecten ervoor zorgen dat elke volgende zoekopdracht beter wordt.

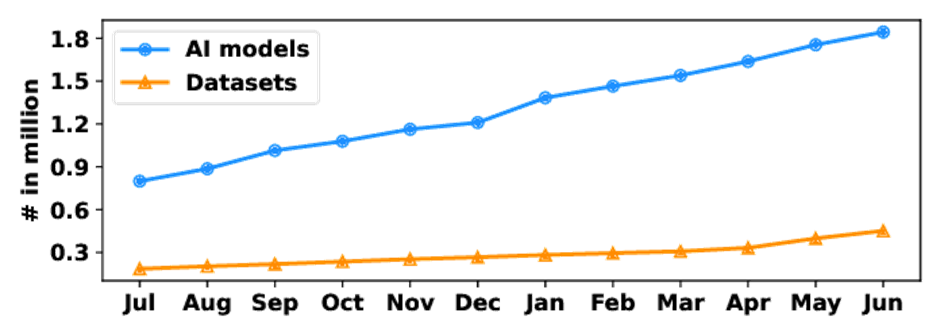

Bij AI is dat voorlopig echter niet het geval: zoals Deepseek vorig jaar aantoonde, is het wel degelijk mogelijk om met een relatief beperkt budget een model te maken dat niet veel achterop zit op de industry leaders. Bovendien is er – zeker vanuit China – ook een stevige push richting open source modellen. Wat ervoor zorgt dat er ondertussen al meer dan 2 miljoen verschillende AI-modellen bestaan.

Het is nog vroeg in de AI-strijd. En time will tell. Maar het is een opvallende vaststelling dat er enerzijds stevig geïnvesteerd wordt in datacenters – zoals je bij een winner-takes-all markt zou verwachten – terwijl anderzijds het aantal modellen en hun gebruik eerder het omgekeerde doet vermoeden. Bovendien is first-mover OpenAI momenteel stevig marktaandeel aan het verliezen...

Beyond ChatGPT

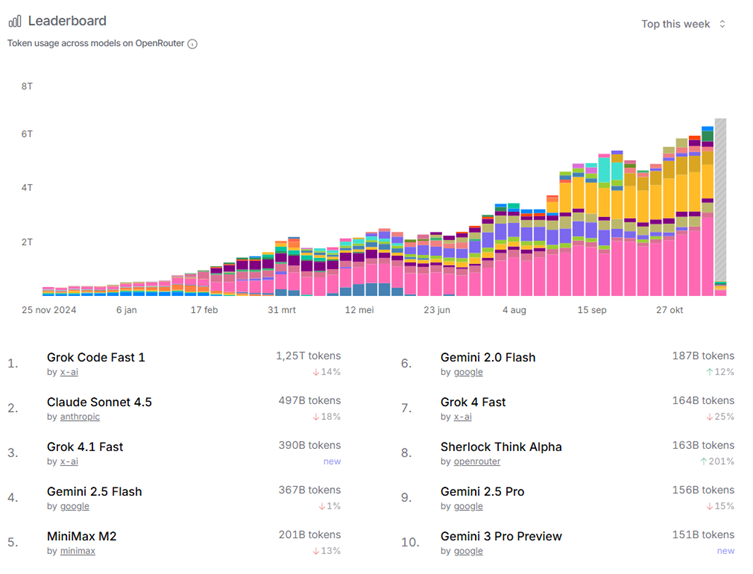

Als het over AI gaat, blijft het in de populaire pers vooral over OpenAI gaan. In realiteit blijft OpenAI populair bij de gewone consument, maar verliest het bedrijf van Sam Altman stevig terrein op de professionele markt.

Terwijl je als consument voor een maandelijks abonnement quasi onbeperkt je persoonlijke AI-assistent op zak hebt, betaalt een professionele partij op basis van je gebruik, met een prijs per gebruikte ‘token’. Platformen als OpenRouter bieden de mogelijkheid om heel flexibel te shiften tussen de verschillende modellen, en zijn dan ook een nuttige proxy om te zien welke modellen het meest gebruikt worden. Hieronder de tabel met de gebruikte tokens over de verschillende modellen heen.

Door promotionele aanbiedingen en gratis versies kon Elon Musk’s Grok 2 podiumplaatsen inpalmen. Daarna doen Gemini en Anthropic’s Claude het bijzonder goed. ChatGPT heeft geen enkel model meer in de top 10 staan… Is er ook bij AI-modellen sprake van een ‘winner’s curse’?

Part III: Over Capaciteit

In een vorige post hadden we het al over de enorme investeringen in AI. De komende jaren zullen de ‘big 5’ techspelers tot meer dan 500 miljard per jaar spenderen aan capex voor de bouw van datacenters. Het zijn bedragen waar we nog amper iets bij kunnen voorstellen. Ter referentie: dat is ongeveer evenveel als de volledige Europese landbouwsector. Of ongeveer 20x de wereldwijde jaaromzet van McDonalds, mocht dat het wel concreet maken…

Het doet vragen rijzen over of dit op termijn niet voor een enorme overcapaciteit gaat zorgen. Zeker gezien heel wat ‘kleinere modellen’ met een beperktere rekenkracht er toch in slagen om 80% van het niveau van de beste modellen te halen. En voor veel taken ‘goed genoeg’ kunnen zijn.

Persoonlijk krijgen we een beetje ‘submarine cable boom’-vibes van begin de jaren 2000. Waarbij internet de wereld ging overnemen, en een enorme overbuild aan overzeese internetkabels gebouwd werd. Uiteindelijk belandden de meeste investeringen ergens in de buurt van de kabels: diep onder water. Maar de infrastructuur die toen gebouwd werd, zorgde er wel voor dat het internet zich de volgende decennia kon ontwikkelen tot wat het vandaag is.

Zijn de huidige AI-spelers de nieuwe onderzeese kabelmaatschappijen? Zorgt de bouwwoede straks voor een overcapaciteit & kelderende prijzen? In dat geval kan je als investeerder beter aan de zijlijn blijven staan. Maar als gebruiker kan je aan zo’n situatie wél veel plezier beleven. Wat denken jullie?

Part IV: AI als StockPicker

Er bestaan wereldwijd meer dan 50,000 beursgenoteerde bedrijven. Als analist is het dan ook onbegonnen werk om die allemaal in detail te gaan kennen. Onder meer daarom zijn computermodellen al decennia lang goed ingeburgerd bij het maken van aandelenselecties: op basis van financiële cijfers worden ratio’s en waarderingsmaatstaven berekend, en gebeurt een eerste filtering.

De nog steeds ruime lijst aan bedrijven die deze screening overleeft wordt als ‘potentieel interessant’ gevlagd. Waarna de analist zijn huiswerk begint te maken. Zoals Warren Buffett het formuleert: je start bij bedrijven met de letter A, dan naar diegene die beginnen met een B, enzovoort…

Het nadeel van deze approach is enerzijds dat de meest interessante info vaak niet in de cijfers zelf zit. Maar eerder in de notes, de vooruitzichten, de guidance die de bedrijfsleiding formuleert, en info die de harde cijfers van de nodige context voorzien. Tot voor kort kon dat enkel door met de nodige discipline aandachtig door alle bedrijfsdocumenten te lezen. En de meest genomen beslissing bij een aandelen-analyse is om er uiteindelijk niet in te gaan investeren: per bedrijf dat uiteindelijk als beleggingswaardig wordt beschouwd, bekijkt een analist er vaak 10 waarop de conclusie ‘njet’ is.

Enter Large Language Modellen (LLM): die zijn net geknipt om door grote hoeveelheden tekst te gaan, en deze te laten samenvatten. Of te zoeken naar inconsistenties, wijzigingen van kwartaal tot kwartaal, en dergelijke meer. Door slim gebruik te maken van (goed getrainde) AI-analisten kan het filter-aspect dus uitgebreid worden, en naast de cijfers ook op de tekst een screening toelaten. Om op die manier alvast de ‘potentieel meest interessante bedrijven’ te gaan flaggen.

Uiteraard blijft het noodzakelijk dat de menselijke analist vervolgens met de nodige kennis en discipline zijn huiswerk maakt. Simpelweg aan ChatGPT vragen wat een interessante investering zou zijn en dat advies blindelings volgen, is uiteraard geen goed idee. Maar een goedgetrainde AI inzetten om documenten te screenen, en zo de lijst van bedrijven waar je als analist dieper op induikt zo relevant en interessant mogelijk te maken, helpt aandelenanalisten om de hit-rate te verhogen.

Part V: Hoe West-Vlaams geld de hoeksteen van de AI-revolutie legde.

Ene Ray Kurzweil voorspelde in 1990 al dat, als de rekenkracht van computers aan hetzelfde tempo blijft verbeteren, we in 2029 op het punt zitten waarop Artificial General Intelligence (AGI) bereikt wordt. Het opvallende is dat we anno 2025 nog steeds op schema zitten om dat doel te bereiken. Nog maar enkele jaren volhouden dus! In dat opzicht is het niet verwonderlijk dat de grote techspelers met grote budgetten richting AI gooien: we kunnen the holy grail bijna aanraken.

Bij West-Vlaamse beleggers met een goed geheugen doet de naam Kurzweil misschien nog wel een belletje rinkelen. In 1998 en in volle dotcom-bubble werd zijn firma, Kurzweil Applied Intelligence, voor 53 miljoen USD cash opgekocht door… Lernout & Houspie.

Toen L&H ten onder ging zat de man met een aardige duit cash en vol passie voor AI-avant-la-lettre. Hij besteedde zijn tijd nuttig, en richtte in 2006 de ‘Singularity Summit’ op, samen met onder meer Peter Thiel. Het is op die Singularity Summit dat Demis Hassabis, de oprichter van Deep Mind, Peter Thiel ontmoette. En zo de nodige funding voor zijn AI-bedrijfje wist los te weken bij onder meer Peter Thiel en… Elon Musk.

Deep Mind werd in 2014 opgekocht door Google voor een slordige 500 miljoen USD. Hoewel hij mee aan de kassa passeerde, was Elon Musk hiermee not amused. Hij probeerde nog een tegenbod te doen, maar dat werd afgewezen door Deep Mind. Als tegenzet begon hij dan maar een nieuw bedrijfje, met als doel AI te ontwikkelen als open source software. Genaamd… OpenAI. De rest is (een verdere woelige) geschiedenis.

Maar met de nodige nuance en editoriale vrijheid kunnen we dus (losjes) stellen dat de West-Vlaamse L&H-belegger mee aan de wieg stond van wat uiteindelijk de huidige AI-golf werd…

Auteurs: Jens Verbrugge, Tibo Dewispelaere, Wouter Verlinden